Die Veränderungen, die Innovationen wie Künstliche Intelligenz mit sich bringen, haben es notwendig gemacht, die Vorschriften der EU an die neuen Gegebenheiten anzupassen. Der nächste große Meilenstein auf diesem Weg wurde am Wochenende erreicht: Vertreter des Europäischen Parlaments, des Rates der Europäischen Union und der Europäischen Kommission einigten sich im Rahmen der Europäischen KI-Strategie1 auf eine vorläufige Version des sogenannten Artificial Intelligence Act (KI-Gesetz), über die so bald wie möglich final abgestimmt werden soll.2

Die Europäische Union hat sich das Ziel gesetzt, das Gesetz- und Regelsystem zu Grundrechten und zur Sicherheit zu verbessern und eine wirksame Durchsetzung der bereits vorhandenen Rechtsvorschriften zu ermöglichen.

Die Regeln des AIA sollen Rechtssicherheit gewährleisten – also klar festlegen, was rechtlich erlaubt ist, um einen Handlungsspielraum vorzugeben, auf den Bürger und Unternehmen sich verlassen können. Diese Rechtsicherheit soll Investitionen und Innovationen im Bereich der KI erleichtern und die Entwicklung eines Binnenmarktes für rechtmäßige, sichere und vertrauenswürdige KI-Anwendungen erleichtern und gleichzeitig eine Fragmentierung des Marktes verhindern.

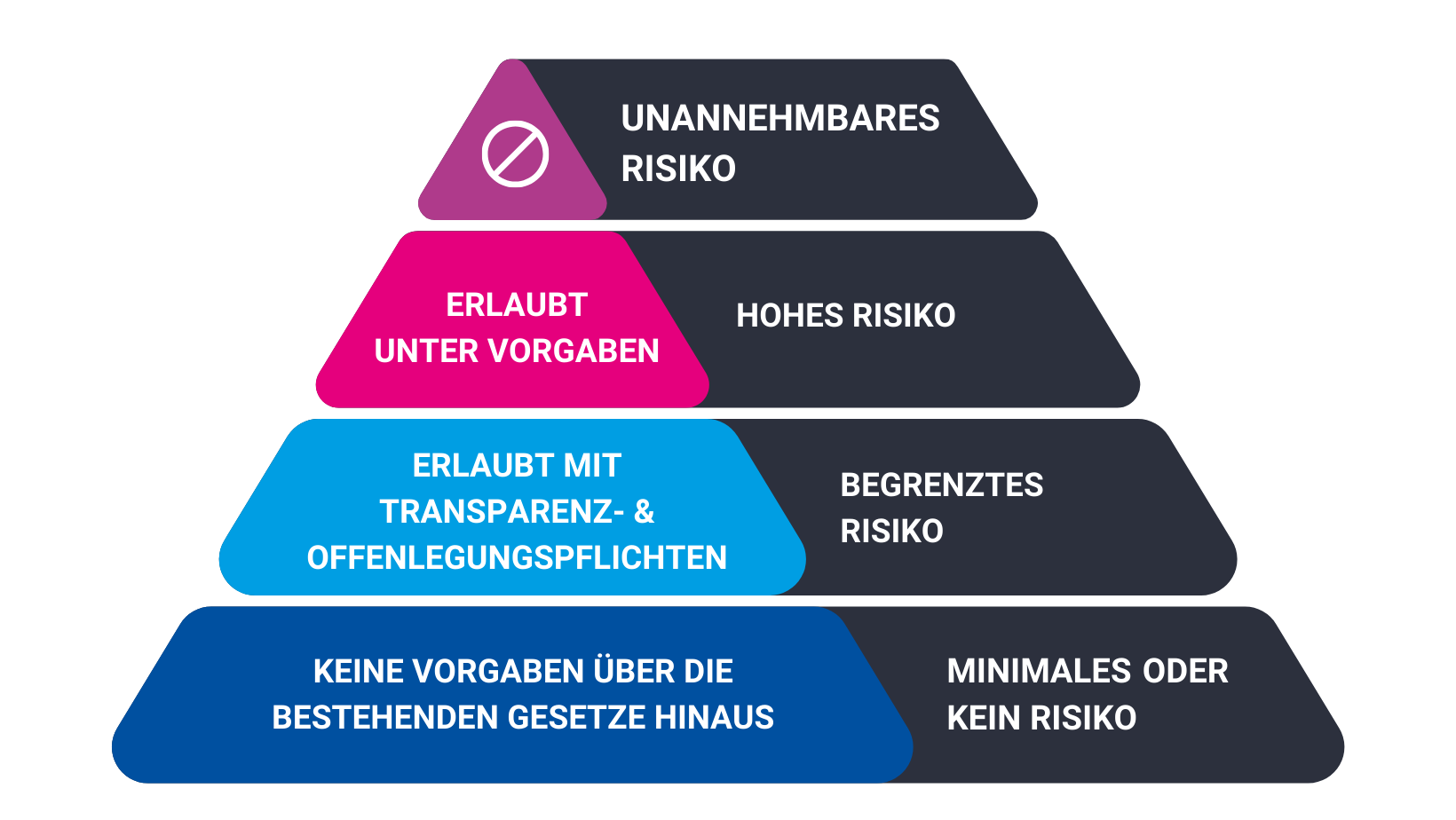

Um den Balanceakt zwischen Unternehmerfreundlichkeit, Wissenschaftsförderung und Verbraucherschutz zu meistern, wurde ein vierstufiges Regulierungssystem vereinbart. Dieses basiert auf den Risikoprofilen3 und der Größe der Modelle bzw. der Anwendungen.

Und lässt Raum für Experimente: Für die Entwicklung von KI können von den nationalen Behörden „Sandboxes“ geschaffen werden, in denen dann unter strenger Regulierungsaufsicht lockerere Auflagen gelten. Unter welche Einstufung Unternehmen fallen, sollen sie selbst festlegen dürfen.

Transparenzpflichten für KI-Systeme mit einem keinem oder einem begrenzten Risiko

Als KI-Systeme mit geringem Risiko gelten Anwendungen wie Chatbots. In diesem Bereich muss für den Nutzer klar sein, dass die Interaktion mit einer KI erfolgt. Diese Transparenz soll dem Nutzer ermöglichen, die Ergebnisse einzuordnen, fundierte Entscheidungen über die weitere Verwendung zu treffen oder gegebenenfalls auf die Nutzung zu verzichten.

Auch wer KI-erzeugten Content verwendet, muss dies transparent tun. Das bedeutet, das KI-generierte Inhalte, wie mit KI erstellte Texte oder Bilder, als solche gekennzeichnet werden müssen.

Kein oder ein minimales Risiko wird Anwendungen wie Spamfiltern zugeschrieben – sie werden nicht reguliert.

Regulierung von Basismodellen

Basismodelle sind große neuronale Netzwerke. Zu diesen Modellen gehören zum Beispiel große Sprachmodelle (LLM) wie GPT (Generative Pre-trained Transformer), welches die Basis für ChatGPT bildet. Für die Anbieter dieser großen Modelle, wie OpenAI, wurden strenge Regeln festgelegt, darunter die Pflicht zur Erstellung technischer Dokumentationen und zur Einhaltung des EU-Urheberrechts.

Kontrolliert werden soll die Einhaltung von Rechten durch detaillierte Zusammenfassungen der für das Training verwendeten Inhalte. Diese Zusammenfassungen müssen durch die Anbieter bzw. Ersteller der Modelle bereitgestellt werden. Indem die EU den Fokus auf den Bereich der Daten legt, wird die Kontrolle auf Basis der Daten durchgeführt, mit denen die Modelle lernen und nicht auf konkrete, derzeit vorhandene Technologien beschränkt. Dadurch werden auch zukünftige Entwicklungen eingeschlossen.

Strenge Vorschriften für KI mit hohem Risikopotenzial

Noch strengere Verpflichtungen gibt es für die Anbieter von risikoreicher KI. Als risikoreiche KI-Systeme werden unter anderem Anwendungen zum Management von Arbeitnehmern oder Bewerbungsprozessen, zur Bewertung von Prüfungen oder zur Beurteilung der Kreditwürdigkeit oder rechtlicher Sachverhalte eingeordnet. Aber auch KI, die in kritischen Infrastrukturen, im Bildungsbereich oder medizinischen Geräten eingesetzt wird, birgt ein hohes Risikopotenzial.

Bevor diese Systeme auf den Markt gebracht werden, müssen die Entwickler eine Reihe von Verpflichtungen erfüllen, die über die Anforderungen an risikoreiche KI-Systeme hinausgehen. Dazu gehören Modellbewertungen zum systemischen Risiko, die Gewährleistung der Cybersicherheit und die Implementierung angemessener Risikominderungssysteme.

Wesentlich ist die ständige menschliche Überwachung, um solche Systeme zu kontrollieren.

Diese Anwendungen verbietet der AI ACT

KI-Anwendungen, die ein inakzeptables, sehr hohes Risiko mit sich bringen, werden verboten. Dazu gehören:

- Kategorisierungssysteme, die Menschen anhand sensibler Merkmale wie politischer Orientierung oder Glaubensrichtungen einordnen

- Ziellose Sammlungen und Nutzung von Gesichtsaufnahmen aus dem Internet oder von Videoaufnahmen (Scraping)

- Emotionserkennung am Arbeitsplatz oder in Bildungseinrichtungen

- KI, die zur Manipulation von menschlichem Verhalten eingesetzt wird oder Schwächen ausnutzt

- KI, die eine soziale Bewertung basierend auf dem Verhalten oder persönlichen Merkmalen durchführt (Social Scoring)

Durch das Verbot dieser Anwendungen sollen demokratische Prozesse und die Sicherheit, der Lebensunterhalt und die Rechte von Menschen geschützt werden.

Auch dort gibt es eine Ausnahme: Nach einer richterlichen Genehmigung sollen Strafverfolgungsbehörden biometrische Fernidentifizierungssysteme (z.B. Gesichtserkennung) in öffentlich zugänglichen Räumen für bestimmte Verbrechen zeitlich begrenzt einsetzen dürfen. Dazu gehören neben Straftaten wie Terrorismus oder Entführung auch der Vorwurf der Umweltkriminalität. Eine Überwachung ohne Anlass hat die EU verboten.

Haftung für Schäden durch (den Einsatz von) Künstlicher Intelligenz

Nicht beantwortet wird im AI-Act, wer haftet, wenn durch KI oder unter Verwendung von KI Schäden verursacht werden.

Europäische und in Europa verkaufte Produkte müssen Gesundheits-, Sicherheits- und Umweltanforderungen erfüllen. Wie diese Anforderungen im Detail bei komplexen KI-Anwendungen und bei selbstständig handelnden Systemen erweitert werden müssen und kontrolliert werden können, ist unklar. Entstehen durch sie Probleme, sollten eingetretene Schäden wirksam behoben werden. Dafür muss aber auch klar sein, wer dafür verantwortlich ist:

- Im Falle eines Autounfalls etwa der Hersteller, der Nutzer oder das autonome Fahrzeug?

- Im Falle einer Urheberrechtsverletzung durch einer mit Text-zu-Bild-Software erstellten Grafik der Nutzer, der es ungeprüft in den Umlauf bringt, oder der Anbieter der Software?

Wie können in einem Bereich, der mittlerweile technologisch hochkomplex ist, Beweise für oder gegen einen Mangel nachgewiesen werden?

Fragestellungen, die uns in Zukunft weiter beschäftigen werden, für deren Beantwortung die EU aber noch keine endgültigen Hinweise geben kann. Die Verabschiedungen der Richtlinien zur zivilrechtlichen Haftung und zur Produkthaftung stehen noch aus. Im Oktober 2023 starteten die Trilogverhandlungen zur Erneuerung der seit 1985 besehenden Produkthaftungsregeln4, die nächste Sitzung ist für morgen geplant.5 Nach dem Ende des Trilogs muss der getroffene Vorschlag sowohl vom EU-Parlament als auch vom Rat formell angenommen werden, um in Kraft zu treten.

Dieser Weg steht auch dem AI Act noch bevor. Deshalb werden die Vorgaben aus dem Gesetz zur Künstlichen Intelligenz nicht vor Ende 2025 oder Anfang 2026 in Kraft treten, und es ist durchaus möglich, dass sich einige Details in den Feinabstimmungen noch ändern werden.

Anwendung vom KI im Unternehmensalltag

Mit dem Thema Künstliche Intelligenz müssen sich europäische Gewerbetreibende und Unternehmen trotzdem jetzt schon auseinandersetzen, denn auch bereits bestehende deutsche oder nationale Regelungen im Vertragsrecht, zur Geheimhaltung oder im Datenschutz setzen einen Rahmen zum rechtssicheren Umgang mit Künstlicher Intelligenz.

Empfehlenswert ist dabei unter anderem eine ausführliche Risikoabschätzung vor dem Einsatz von KI-Anwendungen und klare unternehmensinterne Richtlinien für die Nutzung von KI – besonders in sensiblen Bereichen wie HR oder Buchhaltung. Welche weiteren Maßnahmen getroffen werden und gegebenenfalls vertraglich abgesichert werden müssen, hängt im Einzelfall von der Art der Nutzung und der getroffenen Risikoeinschätzung ab. Wir beraten Sie hierzu gern.

Für Anbieter von KI-Lösungen oder Produkten, die KI-Modelle nutzen, ist wichtig, bereits jetzt die gesetzlichen Anforderungen der EU mitzudenken und in der Produktentwicklung zu beachten. Darüber hinaus wird in Anbetracht der geforderten Transparenzregeln und Dokumentationspflichten der Schutz der eigenen Lösungen durch Patente oder andere Schutzrechte für Entwickler wichtiger. Durch sie könnten Konkurrenten daran gehindert werden, kostenintensive Entwicklungen zu kopieren und auf den Markt zu bringen – ein Problem, welches für innovationsgetriebene Unternehmen durch die ausführlichen Dokumentations- und Offenlegungspflichten in Zukunft noch größer werden dürfte. Unser Patentteam beantwortet gerne ihre Fragen zur Schutzfähigkeit Ihrer Lösungen im Bereich Künstliche Intelligenz, Software und Robotics.